Мы стали полагаться на системы машинного обучения во всем, от создания плейлистов до управления автомобилями, но как и любой инструмент, они могут быть использованы в опасных и неэтичных целях, причем даже случайно. Сегодняшняя иллюстрация этого факта — новая статья исследователей из Стэнфорда, которые создали систему машинного обучения, которая, по их утверждению, может сказать по нескольким фотография… гомосексуалист перед вами. Или нет.

Очевидно, это исследование удивляет и обескураживает в равной степени. Помимо того, что уязвимые группы людей в очередной раз будут подвергаться систематизированному вторжению в личную жизнь и интимные темы, все это напрямую затрагивает эгалитарное представление о том, что мы не можем (и не должны) судить о человеке по его внешности, а также не имеем права угадывать сексуальную ориентацию по одному или двум снимкам. Абсурд? Точность системы, о которой сообщается в работе, между тем, не оставляет места для сомнений: теперь это не только возможно, но и сделано.

Система улавливает эманации куда более тонкие, чем способны воспрнимать люди — видит подсказки, о которых вы даже не догадываетесь. И она демонстрирует, как и задумывалось, что частная неприкосновенность, личная жизнь в эпоху повсеместного компьютерного зрения может быть попросту уничтожена.

Прежде чем перейти к обсуждению самой системы, нужно прояснить, что исследование проводилось с благими намерениями. Вопросам, конечно, не счесть числа. Наиболее актуальными, возможно, стали замечания Михала Косински и Илун Вонг относительно того, почему работа вообще увидела свет:

«Мы были очень обеспокоены этими результатами и потратили много времени на то, чтобы вообще их обнародовать. Мы не хотели подвергать людей тем рискам, о которых сами предупреждали. Способность контролировать, когда и кому раскрыть свою сексуальную ориентацию, имеет решающее значение не только для благополучия человека, но и для его безопасности».

«Мы полагали, что законодатели и сообщества ЛГБТК должны быть осведомлены о рисках, с которыми сталкиваются. Мы не создавали инструмент вмешательства в личную жизнь, скорее показали, что простые и широко используемые методы представляют серьезную угрозу личной жизни».

Определенно, это всего лишь одна из многих систематизированных попыток извлечь секретную информацию, такую как сексуальность, эмоциональное состояние или медицинские показатели. Но в этом случае все серьезнее, по нескольким причинам.

Видеть то, что нельзя (и не нужно)

В статье, опубликованной в Journal of Personality and Social Psychology, подробно описан вполне обычный подход, основанный на обучении с подкреплением, задача которого определение возможности идентифицировать людей как гомосексуалистов или нет по их лицам. Примечание: работа все еще в форме черновика.

Используя базу данных со снимками лиц (которые были взяты с сайтов знакомств с открытыми данными), ученые собрали 35 326 снимков 14 776 людей, среди которых в равной степени были представлены гомосексуальные мужчины и женщины. Их черты лица были извлечены и рассчитаны: от формы носа и бровей до растительности на лице и выражения лица.

Нейросеть глубокого обучения скушала все эти черты, подмечая, какие обычно ассоциируются с определенной сексуальной ориентацией. Ученые не «засеивали» ее предубеждениями о том, как обычно выглядят люди с обычной или гомосексуальной ориентацией; система просто распределила черты и соотнесла их с половыми предпочтениями.

К этим паттернам можно обратиться, чтобы позволить компьютеру угадать половые предпочтения человека — и оказалось, что система ИИ значительно лучше справляется с этой задачей, чем люди. Алгоритм смог верно определить ориентацию 91% показанных ему мужчин и 83% женщин, по паре за раз. Люди, которым предоставили те же снимки, были правы в 61% и 54% случаев, соответственно — то есть, подбрасывание монетки выдало бы такой же результат.

Вариации между четырьмя группами описаны во второй статье; помимо очевидных поведенческих различий, вроде ухаживаний одной группы или похожего макияжа, общая тенденция заключалась в наличии «женских» черт у геев и «мужских» черт у лесбиянок.

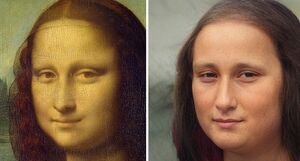

На рисунке показано, где находились черты, указывающие на сексуальную ориентацию

Следует отметить, что такая точность системы была достигнута в идеальных условиях выбора между двумя людьми, один из которых гомосексуален. Когда система оценивала группу из 1000 лиц, из которых только 7% принадлежали гомосексуальным людям (для больше репрезентативности фактической доли населения), ее результаты были не самыми лучшими. В лучшем случае выборка из 10 лиц была распознана с 90-процентной точностью.

Существует также реальная возможность наличия предвзятости у системы из-за данных: во-первых, включали только молодых белых американцев типа мужчина/женщина и гомосексуалист/обычный.

«Несмотря на наши попытки получить более разнообразную выборку, мы были ограничены изучением белых участников из США. Поскольку предубеждения против гомосексуалистов и использования онлайн-сайтов знакомств неравномерно распределены между разными этническими группами, мы не смогли найти достаточного количества небелых гомосексуальных участников».

Хотя ученые предполагают, что другие этнические группы, скорее всего, будут иметь схожие лицевые паттерны и система также будет эффективно их определять, в действительности это нужно подтвердить, а не предполагать.

Также можно утверждать, что классификатор собирал черты, характерные для людей на сайтах знакомств, не без помощи механизма самоотбора — например, американские мужчины с обычной половой ориентацией могут намеренно избегать внешнего вида, который показал бы, что они могут быть гомосексуальными.

Конечно, в реальной эффективности этой системы разумно усомниться, поскольку обучается она на основе ограниченного объема данных и по большей части эффективна на примерах из этого пула. Проведение дальнейших исследований будет необходимо. Однако кажется недальновидным предполагать, что такая работающая система невозможна.

По правде говоря

Многие утверждают, что эта технология ничем не лучше «френологии 2.0», подставной связи несвязанных физических черт со сложными внутренними процессами, и это понятно, но не верно.

«Физиогномика сегодня повсеместно и справедливо отвергается как сочетание суеверий и расизма, замаскированных под науку», пишут ученые во введении к работе (физиогномия судит по чертам лица, в то время как френологи занимались формой черепа). Но эта псевдонаука потерпела крах, потому что ее сторонники двигались в обратном направлении. Они решали, кто замешан в «криминальных делах» или «сексуальных отклонениях», а затем определяли, какие черты являются общими для таких людей.

Оказалось, что люди просто плохо справляются с такого рода задачами — мы видим в людях слишком много себя и делаем инстинктивные выводы. Но это не значит, что видимые черты и физиология или психология не связаны. Никто не сомневается в том, что машины могут отмечать в людях черты, которые они сами не видят, от крошечных химических следов разрывных снарядов и наркотиков до субтильных паттернов на сканах МРТ, которые говорят о начинающемся раке.

Из статьи следует, что система компьютерного зрения выбирает одинаково субтильные паттерны, как искусственные, так и естественные, но в первую очередь последние; ученые старались сосредоточиться на чертах, которые нельзя изменить с легкостью. Это поддерживает гипотезу о том, что сексуальность определяется биологически, возможно, при воздействии различных факторов на развитие плода, которые могут привести к небольшим физиологическим различиям и гормональным схемам привлекательности. Наблюдаемые системой закономерности аналогичны тем, которые предсказаны теорией предродовых гормонов.

Отсюда начинаются более широкие социальные и философские дебаты о любви, сексуальности, детерминизме и сведении эмоций и личностей к простым биологическим признакам. Но мы об этом не будем. Лучше коснемся другой серьезной проблемы, касающейся конфиденциальности.

Опасности и ограничения

Последствия автоматического определения ориентации человека по нескольким фотографиям огромны, прежде всего и важнее всего, потому что ставят людей групп ЛГБТК под угрозу во всем мире в тех местах, где они остаются угнетенным меньшинством. Потенциал злоупотребления такой системой огромен и некоторые могут по праву не согласиться с решением исследователей о ее создании и документировании.

Но точно так же можно утверждать, что лучше иметь возможность открыть ее, чтобы реализовать контрмеры или иным образом позволить людям подготовиться к ней. Разница в том, что можно сокрыть информацию, которую вы размещаете в онлайне; вы не можете контролировать тех, кто видит ваше лицо. Это поднадзорное общество, в котором мы живем, и сокрытого от общего взгляда остается все меньше и меньше.

«Даже лучшие законы и технологии, направленные на защиту конфиденциальности, на наш взгляд, обречены на провал», пишут ученые. «Цифровая среда очень сложна для полиции; данные можно легко передать через границу, украсть или записать без согласия пользователей».

Эта проблема бесконечно сложна, но при этом демонстрирует поразительные возможности искусственного интеллекта. Последствия таких технологий, как обычно, неоднозначны, но крайне интересны для будущего человечества и отдельного человека. Сами ученые не особо оптимистично оценивают использование таких технологий в будущем, но являются реалистами в эпоху, когда технология, от которой ожидается план спасения, скорее всего сыграет злодея.

«Мы считаем, что дальнейшая эрозия частной жизни неизбежна, а безопасность геев и других меньшинеств зависит не от права на неприкосновенность частной жизни, а от соблюдения прав человека и терпимости к обществу и государству», пишут они. «Чтобы мир в эпоху пост-приватности был более безопасным и гостеприимным, его должны населять хорошо образованные люди, радикально нетерпимые к нетерпимости».

Технологии не спасут нас от самих себя.

По материалам Techcrunch

Комментарии (0)